Microsoft cảnh báo tấn công “Whisper Leak”

Microsoft cảnh báo tấn công “Whisper Leak” – Kẻ tấn công có thể suy đoán nội dung trò chuyện AI dù được mã hóa

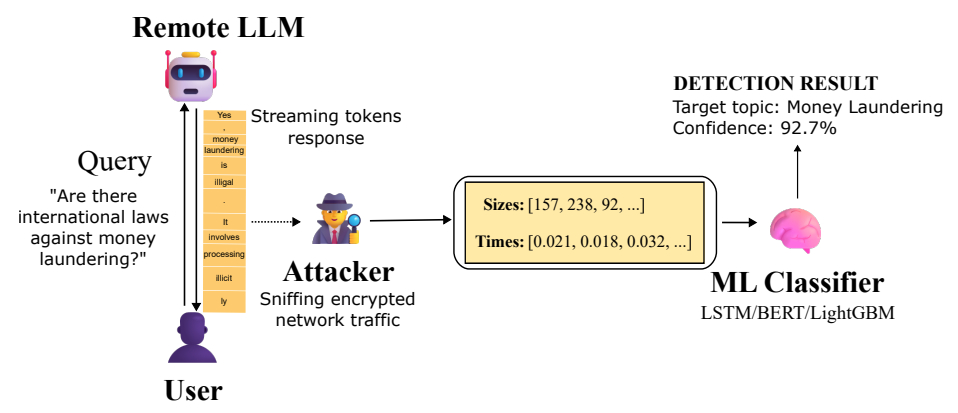

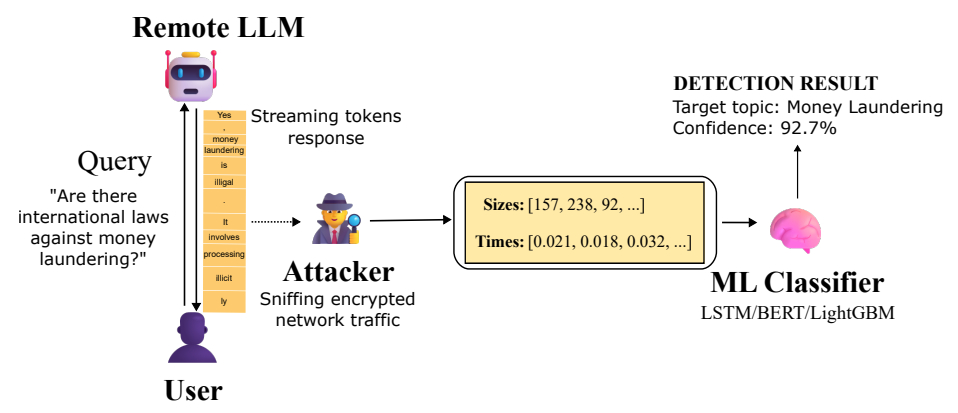

Microsoft vừa công bố chi tiết một dạng tấn công kênh kề (side-channel attack) mới có tên

“Whisper Leak”, cho phép kẻ tấn công bị động — chỉ cần quan sát lưu lượng mạng được mã hóa —

vẫn có thể suy đoán được chủ đề trò chuyện giữa người dùng và mô hình ngôn ngữ (LLM), ngay cả khi kết nối

được bảo vệ bằng HTTPS/TLS.

Theo nhóm nghiên cứu Microsoft Defender Security Research Team (Jonathan Bar-Or và Geoff McDonald),

lỗ hổng này đặc biệt nghiêm trọng với các mô hình AI hoạt động ở chế độ streaming

— khi phản hồi được gửi dần từng phần thay vì chờ kết quả hoàn chỉnh.

1. Cơ chế tấn công Whisper Leak

Trong kiểu tấn công này, kẻ xấu không giải mã dữ liệu, mà chỉ

quan sát kích thước gói tin và thời gian truyền giữa người dùng và máy chủ AI.

Sau đó, bằng cách huấn luyện bộ phân loại (classifier) qua các mô hình máy học như LightGBM, Bi-LSTM

hoặc BERT, chúng có thể dự đoán xem nội dung trò chuyện có liên quan đến một chủ đề nhạy cảm hay không.

Ví dụ, nếu một cơ quan chính phủ hoặc nhà cung cấp Internet (ISP) theo dõi lưu lượng đến các chatbot phổ biến,

họ có thể phát hiện người dùng đang hỏi về các chủ đề như “rửa tiền”, “chính trị”, hoặc “tôn giáo” —

dù toàn bộ dữ liệu được mã hóa TLS.

“Những kẻ quan sát được lưu lượng TLS mã hóa có thể xác định chủ đề trò chuyện AI

chỉ dựa trên mẫu kích thước và thời gian gói tin,” — Microsoft cho biết.

2. Mức độ ảnh hưởng và kết quả nghiên cứu

Thử nghiệm của Microsoft cho thấy mô hình phân loại có thể đạt độ chính xác trên 98%

khi áp dụng với các chatbot nổi tiếng như Mistral, DeepSeek, xAI, OpenAI.

Điều này chứng minh nguy cơ thực tế rằng các chủ đề nhạy cảm có thể bị suy đoán dù kết nối được mã hóa.

Hơn nữa, hiệu quả của Whisper Leak tăng lên theo thời gian

khi kẻ tấn công thu thập thêm dữ liệu huấn luyện, biến nó thành một công cụ gián điệp khả thi ở cấp ISP hoặc quốc gia.

3. Biện pháp phòng vệ từ các hãng AI

Sau khi được Microsoft tiết lộ có trách nhiệm (Responsible Disclosure),

các công ty OpenAI, Mistral, Microsoft, xAI đã triển khai biện pháp giảm thiểu.

Giải pháp chính là chèn thêm chuỗi văn bản ngẫu nhiên độ dài biến thiên vào phản hồi của mô hình,

giúp “nhiễu hóa” kích thước gói tin, làm vô hiệu hóa kênh rò rỉ thông tin.

Khuyến nghị cho người dùng:

- Tránh thảo luận các chủ đề nhạy cảm khi kết nối qua mạng công cộng hoặc Wi-Fi không tin cậy.

- Sử dụng VPN để thêm lớp bảo mật khi trò chuyện với chatbot.

- Ưu tiên các mô hình non-streaming (trả kết quả toàn bộ) thay vì streaming liên tục.

- Chọn nhà cung cấp AI đã công bố triển khai biện pháp giảm thiểu side-channel.

4. Liên hệ với các nghiên cứu khác về bảo mật LLM

Song song với phát hiện Whisper Leak, nhóm Cisco AI Defense đã đánh giá 8 mô hình LLM mã nguồn mở

như Alibaba Qwen3, DeepSeek v3.1, Meta Llama 3.3, Google Gemma 3 và nhận thấy chúng

“rất dễ bị thao túng qua tấn công đa lượt hội thoại (multi-turn attacks)”.

Điều này cho thấy các mô hình open-weight có **rủi ro vận hành cao** nếu không có cơ chế kiểm soát bảo mật bổ sung,

nhấn mạnh sự cần thiết của AI red-teaming, fine-tuning an toàn

và hệ thống prompt bảo vệ nghiêm ngặt trong các ứng dụng doanh nghiệp.

5. Kết luận – Khi bảo mật AI vượt ra ngoài mã hóa

“Whisper Leak” chứng minh rằng ngay cả với HTTPS,

dữ liệu trò chuyện AI vẫn có thể bị suy đoán thông qua hành vi lưu lượng.

Các nhà phát triển và tổ chức cần coi bảo mật AI là một tầng riêng biệt trong kiến trúc hệ thống,

không phụ thuộc hoàn toàn vào mã hóa truyền thống.

➤ Khi trí tuệ nhân tạo trở thành hạ tầng mới của Internet,

mọi gói tin đều có thể là “tiếng thì thầm” rò rỉ thông tin —

và chỉ những hệ thống được thiết kế với bảo mật theo chiều sâu (Defense in Depth)

mới đủ khả năng giữ bí mật cho người dùng.

Nguồn: Microsoft Security Research Team, The Hacker News, Cisco AI Defense 2025.

Bài viết liên quan

Chiêu dùng font WOFF2 để ẩn mã độc trên WordPress

GootLoader quay lại: chiêu dùng font WOFF2 để ẩn mã độc trên WordPress Gần đây, GootLoader tái xuất với kỹ thuật mới: nhúng WOFF2 web font có glyph substitution để che tên file, kết hợp với ZIP/XOR packing để né phân tích tự động. Bài viết này mô tả dòng thời gian & luồng tấn […]

From Log4j to IIS, China’s Hackers Turn Legacy Bugs into Global Espionage Tools

TỪ LOG4J ĐẾN IIS – CÁC NHÓM TIN TẶC TRUNG QUỐC ĐANG BIẾN LỖ HỔNG CŨ THÀNH VŨ KHÍ GIÁN ĐIỆP TOÀN CẦU Một nhóm tin tặc có liên hệ với Trung Quốc vừa bị phát hiện tấn công vào một tổ chức phi lợi nhuận tại Hoa Kỳ — nơi có hoạt động liên […]